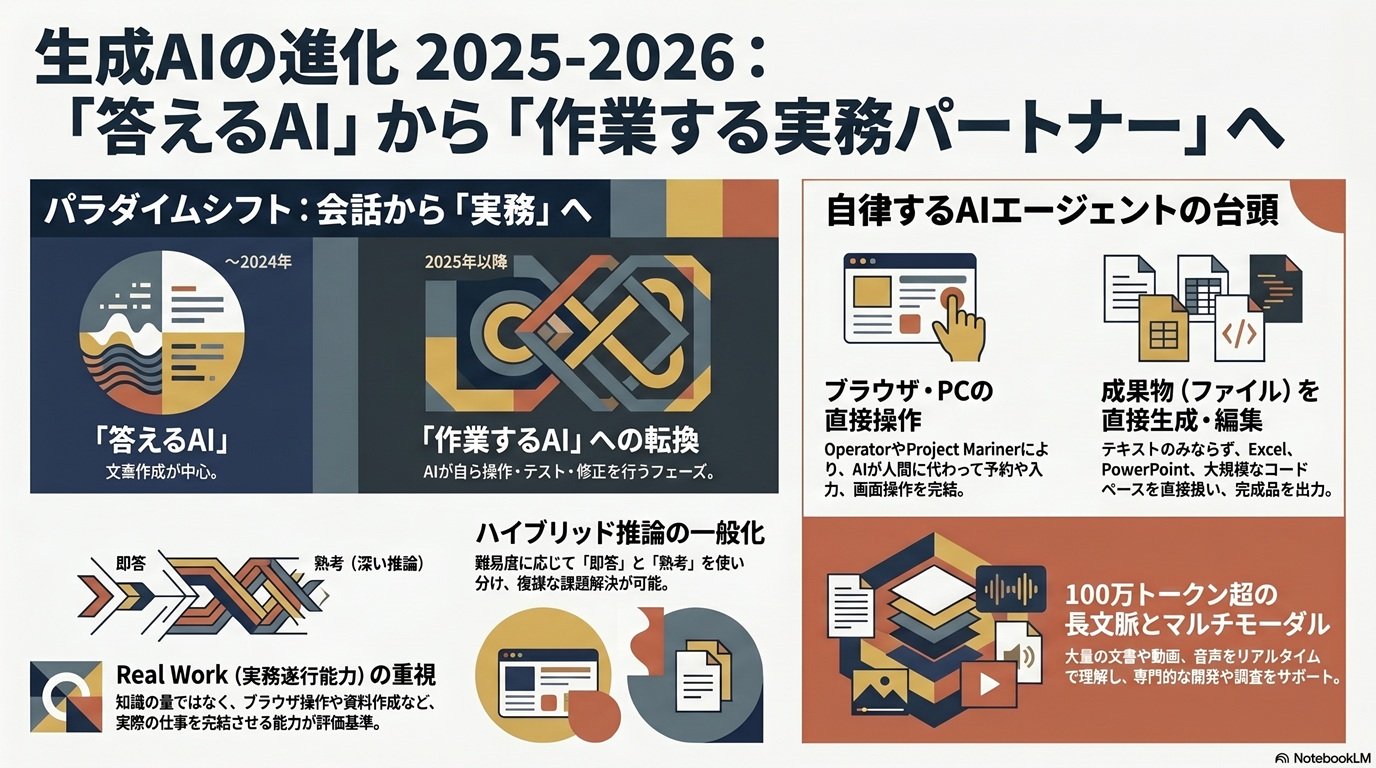

2025年から生成AIは「会話」から「作業」へ変わってきました

2025年1月から2026年5月10日までの生成AIの動きを見ていると、かなり大きく変わったなと思います。2024年までは、ChatGPTに聞いて文章を書いてもらう、画像を作る、コードを少し直してもらう、という使い方が中心でした。もちろんそれだけでも十分すごかったのですが、2025年以降は少し違います。

AIがブラウザを操作する。

AIが調査してレポートを作る。

AIがコードを書くだけでなく、実際に修正してテストする。

AIがExcel、PowerPoint、PDF、スライド、動画、音声まで扱う。

このあたりが一気に進みました。

なので、2025年から2026年前半の生成AIを一言で見るなら、「答えるAI」から「作業するAI」へ変わってきた時期だったと思います。

OpenAI / ChatGPTの動き

OpenAIは、この期間に一番動きが分かりやすかった会社だと思います。

ChatGPTが単に会話するだけでなく、ブラウザを操作したり、深く調査したり、コードを書いたり、資料を作ったりする方向へ進みました。

| 時期 | モデル・機能 | 内容 |

|---|---|---|

| 2025年1月 | Operator / Computer-Using Agent | ChatGPTが自分のブラウザを使って、クリックや入力をしながら作業するOperatorを発表 |

| 2025年1月 | o3-mini | 数学、科学、コーディング向けの低コスト・低遅延な推論モデル |

| 2025年2月 | deep research | 複数ステップのWeb調査を行い、資料を読みながらレポートを作る機能 |

| 2025年2月 | GPT-4.5 | 会話の自然さ、知識、意図理解、ハルシネーション低減を重視した研究プレビュー |

| 2025年3月 | GPT-4o画像生成 / 新音声モデル | 画像生成、文字入り画像、画像編集、音声エージェント向けモデルを強化 |

| 2025年4月 | GPT-4.1 API / o3 / o4-mini | API向けGPT-4.1、ChatGPT向けo3・o4-miniを展開。画像を見ながら考える方向も強化 |

| 2025年5〜6月 | Codex | コーディング支援を本格化。コード生成だけでなく、実務開発に近い作業へ |

| 2025年7月 | ChatGPT agent | Operatorとdeep researchの流れをChatGPT内に統合。仮想PCで作業するagent modeへ |

| 2025年8月 | GPT-5 | 即答と深い推論を切り替えるモデルとして登場 |

| 2025年9月 | Sora 2 | 動画と音声生成を強化。物理的一貫性や音声同期が話題に |

| 2025年11月 | GPT-5.1 | InstantとThinkingを投入。会話の自然さ、指示追従、複雑タスクへの粘りを強化 |

| 2025年12月 | GPT-5.2 / GPT-5.2-Codex | Instant、Thinking、Proを展開。Codex系は大規模コード修正や移行作業に強くなった |

| 2026年2〜3月 | Codex app / GPT-5.3-Codex / GPT-5.4 | CodexアプリやGPT-5.4が登場。専門業務、コーディング、ツール利用を強化 |

| 2026年4〜5月 | GPT-5.5 / GPT-5.5 Instant | 実務のための知能として、調査、データ分析、文書、表計算、ソフト操作を重視 |

Operatorが出たのは、今見ると大きかったですね。

それまでは、AIに「このサイトを見て予約して」と言っても、結局は人間が操作する必要がありました。Operatorは自分のブラウザを使って、ページを見て、クリックして、入力するという方向を見せました。その後、2025年7月にChatGPT agentが出て、Operatorとdeep researchがつながりました。つまり、調べるだけでもなく、操作するだけでもなく、調べて、判断して、操作して、資料まで作る方向になったわけです。

Codexも同じ流れですね。コードを聞くAIから、リポジトリを読んで、修正して、テストして、説明するAIに近づいています。これは開発者にとってはかなり大きい変化だと思います。

GPT-5.5では、OpenAI自身も「real work」という言い方をしています。文章がうまいとか、知識があるとかではなく、実際の仕事をどれだけ進められるかが中心になってきました。

Anthropic / Claudeの動き

Claudeは、2025年以降かなり「コーディング」と「長時間作業」に寄せてきた印象があります。

特にClaude Codeは存在感が大きかったです。Claudeは文章が読みやすいという印象がありましたが、2025年以降はエージェント型コーディングの会社という色も強くなりました。

| 時期 | モデル・機能 | 内容 |

|---|---|---|

| 2025年2月 | Claude 3.7 Sonnet / Claude Code | ハイブリッド推論モデルとしてClaude 3.7 Sonnetを発表。Claude Codeも登場 |

| 2025年5月 | Claude Opus 4 / Sonnet 4 | Claude 4世代を発表。コーディング、エージェント、長時間タスク、ツール利用を強化 |

| 2025年8月 | Claude Opus 4.1 | Opus 4の改良版。エージェントタスクや実務コーディングを改善 |

| 2025年9月 | ファイル作成・編集 / Claude in Xcode | Excel、文書、PowerPoint、PDFなどの作成・編集に対応。Xcode統合も進む |

| 2025年9月 | Claude Sonnet 4.5 | コーディング、エージェント、コンピュータ操作に強いモデルとして登場 |

| 2025年10月 | Claude Haiku 4.5 | 小型・高速・低コストモデル。Sonnet 4に近いコーディング性能を安く速く |

| 2025年11月 | Claude Opus 4.5 | コーディング、エージェント、深い調査、スライド、表計算に強い上位モデル |

| 2026年2月 | Sonnet 4.6 | コーディング、コンピュータ操作、長文推論、1Mトークン文脈ベータが話題 |

| 2026年4月 | Claude Opus 4.7 | 高度なソフトウェアエンジニアリング、長時間タスク、視覚理解、資料作成を強化 |

| 2026年5月 | 計算資源・利用上限の拡大 | モデル性能だけでなく、大量に使えるインフラ競争も見えるように |

Claude 3.7 Sonnetの時点で、即答と拡張思考を切り替える「ハイブリッド推論」という考え方が出てきました。これは2025年のAI全体の流れをよく表していると思います。つまり、常に長く考えるのではなく、簡単なものはすぐ返す。難しいものはしっかり考える。人間でも同じですが、AIもそういう方向に進みました。

Claude Codeは、開発者向けではかなり大きかったですね。単にコードを生成するのではなく、エディタ、GitHub Actions、JetBrains、VS Codeなど、実際の開発環境に入っていく流れです。また、ClaudeがExcel、PowerPoint、PDFなどのファイル作成・編集に対応し始めたのも大きいです。AIが文章を書くだけでなく、成果物そのものを作るようになってきました。

2026年のSonnet 4.6やOpus 4.7では、1Mトークン文脈や長時間タスク、コンピュータ操作、視覚理解がさらに強化されています。Claudeも、完全に「実務で使うAI」へ寄ってきた感じです。

Google / Geminiの動き

Googleは、Gemini 2.0から2.5、3系へと進めながら、マルチモーダルと検索、動画、音声、開発者向けAPIを広げてきました。

Googleはもともと検索、YouTube、Android、Workspace、Cloudを持っているので、AIが入る場所が多いです。そこが強みですね。

| 時期 | モデル・機能 | 内容 |

|---|---|---|

| 2025年1〜2月 | Gemini 2.0 Flash / 2.0ファミリー | 高速応答、マルチモーダル入力、ネイティブツール利用、1Mトークン文脈などを展開 |

| 2025年3月 | Gemini 2.5 Pro Experimental | thinking modelとして登場。複雑な問題、推論、コード生成を強化 |

| 2025年4月 | Gemini 2.5 Flash | 高速・低コストながら、推論をオン/オフできるハイブリッド推論モデル |

| 2025年5月 | Google I/O 2025 / Deep Think / Project Mariner | Deep Think、ネイティブ音声出力、コンピュータ操作能力を持つProject Marinerが話題 |

| 2025年5月 | Veo 3 / Imagen 4 / Flow | 動画生成、画像生成、AI映像制作ツールを発表 |

| 2025年7〜9月 | Gemini APIの実務強化 | Batch Mode、Flash、Flash-Liteなどで大量処理や低コスト処理を強化 |

| 2025年11月 | Gemini 3 | 推論、マルチモーダル理解、コーディングを強化した新世代 |

| 2025年12月 | Gemini 3 Pro Vision / Gemini 3 Flash | 視覚・空間推論、文書、画面、動画理解を強化 |

| 2026年2月 | Gemini 3.1 Pro / Deep Think強化 | Gemini API、Vertex AI、Geminiアプリ、NotebookLMなどへ展開 |

| 2026年3月 | Gemini Embedding 2 / Gemini 3.1 Flash Live | テキスト、画像、動画、音声、PDFを扱う埋め込みとリアルタイム音声対話を強化 |

| 2026年4月 | Gemini 3.1 Flash TTS | 表現力のある音声合成を強化 |

Googleで目立ったのは、Gemini 2.5の「thinking model」という打ち出しです。OpenAIのo系、Claudeのハイブリッド推論と同じように、AIに考えさせる方向がはっきりしました。

また、Project Marinerも重要です。これは、AIがブラウザやPC上の操作をする方向のプロジェクトです。OpenAIのOperatorやChatGPT agentと同じく、AIが実際の画面を扱う流れですね。

Veo 3、Imagen 4、Flowも大きいです。文章やコードだけでなく、動画制作や画像制作の道具としてAIを使う方向です。特に動画は、2025年からかなり競争が激しくなった分野だと思います。

GoogleはGemini単体というより、Search、Workspace、YouTube、Android、Cloudにどう入れていくかが大きいですね。AIモデルだけを比べるより、周辺のサービスまで含めて見る必要があります。

xAI / Grokの動き

xAIのGrokも、2025年から2026年にかけて一気に動きました。

GrokはXとのつながりが強いので、リアルタイム情報やX検索を使うAIという印象があります。そこにコード実行、Web検索、Agent Tools API、音声、動画生成が加わってきました。

| 時期 | モデル・機能 | 内容 |

|---|---|---|

| 2025年2月 | Grok 3 Beta | Grok 3とGrok 3 miniを発表。大規模学習、推論エージェント、Thinkボタンが話題 |

| 2025年7月 | Grok 4 / Grok 4 Heavy | ネイティブツール利用、リアルタイム検索、コード実行、Web閲覧、X検索を統合 |

| 2025年8〜9月 | Grok Code Fast 1 / Grok 4 Fast | エージェント型コーディング向けの高速・低コストモデルを展開 |

| 2025年11月 | Grok 4.1 | クリエイティブ、感情的対話、協働的なやり取りを重視 |

| 2025年11月 | Grok 4.1 Fast / Agent Tools API | 2Mコンテキスト、X検索、Web検索、コード実行、ファイル検索、MCPなどを含むAPI |

| 2025年12月 | Grok Voice Agent API / Collections API / Business | 音声エージェント、RAG的なCollections、企業向けGrok Businessへ展開 |

| 2026年1月 | 大型資金調達 / Grok Imagine API | 画像から動画、テキストから動画、編集、スタイル変更などを拡張 |

| 2026年4〜5月 | 音声API / Custom Voices / Connectors | STT/TTS、音声クローン、メール、スライド、カレンダー、スプレッドシート連携を発表 |

Grok 4.1 FastとAgent Tools APIは、方向性がかなり分かりやすいです。

2Mコンテキスト、X検索、Web検索、コード実行、ファイル検索、MCPなどを組み合わせることで、Grokも単なるチャットAIではなく、エージェント基盤になろうとしています。

xAIはXとの接続があるので、リアルタイム性では強みがあります。ただ、仕事で使う場合は、情報の正確性や出典確認も大事になります。このあたりは、使う側がちゃんと見ないといけないですね。

DeepSeek、Meta、Perplexity、Mistralの動き

OpenAI、Anthropic、Google、xAI以外にも大きな動きがありました。

| 時期 | 企業・モデル | 内容 |

|---|---|---|

| 2025年1月 | DeepSeek-R1 | オープンソースの推論モデルとして大きな話題に。低コスト・高性能モデル競争を加速 |

| 2025年4月 | Meta Llama 4 | ScoutとMaverickを発表。オープンウェイト、マルチモーダル、MoE構造、長文脈が注目 |

| 2025年7月 | Perplexity Comet | AIブラウザCometを発表。検索AIからブラウザ上のパーソナルアシスタントへ |

| 2025〜2026年 | Mistral / Le Chat | Deep Research、Voice、Projects、画像編集、コーディングエージェントなどを強化 |

DeepSeek-R1は、2025年の最初にかなりインパクトがありました。オープンな推論モデルで、低コストでも高性能なモデルが作れるという見方が広がりました。

MetaのLlama 4も、オープンウェイトの流れでは重要です。巨大企業だけが閉じたモデルを提供するのではなく、開発者や企業が自分たちで使えるモデルも強くなってきました。

PerplexityのCometは、AIブラウザという方向です。検索して答えるAIから、ブラウザ上で調査、メール、カレンダー、買い物などを支援する方向に進んでいます。

MistralもLe Chat、Deep Research、Voice、Projects、画像編集、コーディングエージェントなどを広げています。欧州系のAI企業として、独自の位置を作っていますね。

2025年以降に変わったところ

この16か月ぐらいで変わったところを、少し整理してみます。

まず、AIは「考えるモデル」になりました。

OpenAIのo3、o4-mini、GPT-5系。Claude 3.7以降。Gemini 2.5以降。Grok 3以降。各社が、ただ文章を返すのではなく、難しい問題ではしっかり推論する方向に進みました。

次に、AIはエージェントになりました。

Operator、ChatGPT agent、Claude Code、Project Mariner、Grok Agent Tools API。どれも、AIが外部ツールや画面を使って作業する方向です。

さらに、AIはファイルを扱うようになりました。

文章を書くところから、Excel、PowerPoint、PDF、スライド、表計算、コードベース、画像、動画、音声へ広がっています。これはかなり大きいです。人間が最後に整えるだけでなく、AIが成果物そのものを作るようになってきました。

また、マルチモーダルも当たり前になりました。

テキストだけでなく、画像を見て考える。動画を作る。音声で話す。PDFを読む。画面を見て操作する。こういうことが普通になってきています。

最後に、企業利用と開発者利用がかなり進みました。

Codex、Claude Code、Gemini API / Vertex AI、Grok API、Mistral Vibeなどを見ると、個人がチャットで使うだけでなく、仕事の中にAIを組み込む方向が進んでいます。

競争軸も変わってきました

2024年ぐらいまでは、「どのAIが一番賢いか」という見方が多かったと思います。

もちろん今もモデル性能は大事ですが、2025年以降は競争軸が少し分かれてきました。

| 競争軸 | 代表例 |

|---|---|

| 深い推論 | OpenAI o3 / GPT-5系、Claude 3.7以降、Gemini 2.5以降、Grok 3以降 |

| エージェント化 | ChatGPT agent、Claude Code、Project Mariner、Grok Agent Tools |

| 実務ファイル操作 | ClaudeのExcel・PowerPoint編集、ChatGPTの表計算・スライド・文書作業 |

| マルチモーダル | GPT-4o画像生成、Sora 2、Gemini Veo 3 / Imagen 4、Grok Imagine |

| 企業・開発者利用 | Codex、Claude Code、Gemini API / Vertex AI、Grok API、Mistral Vibe |

| 低コスト・高速化 | o3-mini、Gemini Flash、Claude Haiku、Grok Fast、DeepSeek系 |

AIモデルの名前だけを追っていると分かりにくいですが、実際には「何をさせたいか」で選ぶ時代になってきました。

調査ならdeep research系。

コードならCodexやClaude Code。

動画ならSora、Veo、Grok Imagine。

仕事の資料ならChatGPT agentやClaude。

大量処理ならGemini APIや軽量モデル。

そういう使い分けになってきています。

気をつけたいところ

便利になった一方で、気をつけるところもあります。

まず、AIが作業するようになると、間違えた時の影響も大きくなります。文章を少し間違えるだけなら直せばいいですが、ブラウザ操作、ファイル編集、コード修正、メール送信、予約、購入まで進むと、確認が必要です。

次に、情報の鮮度です。

2025年以降はモデル更新が早すぎて、少し前の情報がすぐ古くなります。GPT-5.4が出たと思ったらGPT-5.5、Claude Sonnet 4.5が出たと思ったら4.6、Opus 4.7。追いかけるだけでも大変です。

それから、ベンチマークだけでは分からないところもあります。

数字が高いモデルでも、自分の仕事に合うとは限りません。文章の好み、ファイル操作の安定性、ツール連携、料金、速度、文脈長、出力の癖など、実際に使うと違いがあります。

ゴルフクラブと同じで、スペックだけ見ても合うかどうかは分からないですね。AIも実際に使ってみて、自分の作業に合うかどうかを見るのが大事だと思います。

2025年から2026年前半の生成AIはこう見ています

2025年1月から2026年5月10日までの生成AIは、会話の相手から実務の相棒へ変わってきた時期だったと思います。

最初は、OperatorやClaude Codeのように「AIが作業する」入口が見えてきました。そこから、ChatGPT agent、GeminiのProject Mariner、Grok Agent Tools APIのように、画面やツールを使うAIが増えていきました。

同時に、Sora 2、Veo 3、Imagen 4、Grok Imagineのように、動画や画像の生成も進みました。音声も、会話するだけでなく、音声エージェントやTTS、STT、カスタムボイスの方向へ広がっています。

2026年に入ると、モデル単体の性能だけでなく、どれだけ実際の仕事を進められるかが重要になってきました。GPT-5.5、Claude Opus 4.7、Gemini 3.1、Grok 4.1 Fastあたりを見ると、完全にそちらの方向です。

これからは、「どのAIが賢いか」だけでなく、「どのAIに何を任せるか」が大事になると思います。

文章を書くAI。

調査するAI。

コードを書くAI。

ブラウザを操作するAI。

資料を作るAI。

音声や動画を作るAI。

会社の中のデータにつながるAI。

それぞれ得意なところが違います。

2025年は、生成AIが会話相手から実務パートナーへ変わった年。

2026年は、そのAIがブラウザ、コード、資料、音声、動画まで動かし始めた年。

そう見ておくと、流れが分かりやすいと思います。

参考

Introducing Operator – OpenAI

Introducing ChatGPT agent – OpenAI

Introducing GPT-5.5 – OpenAI

GPT-5.5 Instant – OpenAI

Introducing GPT-5.4 – OpenAI

Introducing GPT-5.3-Codex – OpenAI

Claude Sonnet 4.6 – Anthropic

Claude Opus 4.7 – Anthropic

Grok 4.1 Fast and Agent Tools API – xAI

コメント